🤖 AI 시대, 한글은 왜 최고의 언어 모델인가?: NLP 관점에서 분석하는 데이터 효율성

💡AI의 성공은 '언어'라는 원재료의 품질에 달렸다

💡 요즘 인공지능(AI) 이야기가 뜨겁죠? AI 기술이 발전할수록, 마치 헬스 코치가 우리 몸의 영양소와 효율적인 신진대사를 최적화하듯, AI도 결국 '언어'라는 데이터를 어떻게 효율적으로 섭취하고 처리하느냐가 핵심이 됩니다. 🎯 하지만 여기서 놓치지 말아야 할 중요한 사실 하나! 전 세계 수많은 언어 중에서 유독 한글이 AI 시대에 '최적의 원재료'로 각광받는 이유가 있습니다.

📌 흔히 한글이 '과학적'이라고는 알고 있지만, 이 과학성이 NLP(자연어 처리) 기술에 얼마나 압도적인 효율을 가져다주는지 기술적으로 분석해 보겠습니다. 이 글을 읽고 나면, 왜 한글 기반의 언어 모델이 더 빠르고 똑똑하며, 적은 비용으로 놀라운 성능을 낼 수 있는지 명확히 이해하게 될 거예요. 자, 이제 한글이라는 데이터 보물 창고를 함께 열어봅시다.

🧠 한글의 기본 설계: '초-중-종성'의 모듈식 구성 원리

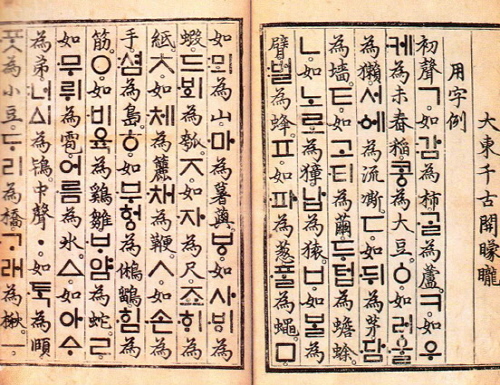

🍎 모든 훌륭한 시스템에는 튼튼한 기본 설계, 즉 모듈식 구성(Modular Structure)이 필요합니다. 한글은 '초성-중성-종성'이라는 단 3개의 구성 요소만으로 모든 음절을 조합해내는 세계 유일의 시스템입니다. 이 구조는 NLP 관점에서 혁명적인 효율성을 제공합니다.

✨ 한글의 구성 요소는 단순하지만, 그 규칙은 놀랍도록 일관됩니다. 이 일관성은 복잡한 굴절어인 한국어의 형태소 분석(Morpheme Analysis) 초기 단계를 단순화하여, 전체 NLP 파이프라인의 첫 단추를 튼튼하고 예측 가능하게 채우는 역할을 합니다. 마치 요리를 시작하기 전에 식재료가 완벽하게 손질되어 있는 것과 같습니다.

📊 데이터 압축률과 트랜스포머 모델의 효율

💰 AI에게 언어를 가르치는 과정을 상상해 보세요. 모델은 입력된 텍스트를 '토큰'이라는 최소 단위로 쪼개서 학습합니다. 영어 같은 알파벳 언어는 글자 자체나 단어(Word)를 토큰으로 사용하지만, 단어의 형태가 조금만 바뀌어도(예: 'run', 'running', 'ran') 모델은 이를 새로운 토큰으로 간주하여 학습해야 하죠.

📉 그러나 한글은 다릅니다. '한', '글', '은'이라는 세 음절을 초성(ㅎ), 중성(ㅏ), 종성(ㄴ) 등 기본 자모로 분리하면, 단 51개의 기본 자모와 조합 규칙만으로 약 11,172개에 달하는 모든 음절을 표현할 수 있습니다. 🚀 이는 모델이 외워야 할 어휘 집합(Vocabulary Size)이 기하급수적으로 줄어든다는 의미입니다.

초월적인 BPE 효율성: 최신 언어 모델에서 사용하는 BPE(Byte Pair Encoding)나 WordPiece 같은 토큰화 기법을 한글에 적용하면, 자모 단위로의 분해가 다른 언어 대비 ‘쓰레기 토큰(Junk Tokens)’ 생성을 압도적으로 억제합니다. 즉, 학습에 필요한 데이터 밀도와 품질이 극대화되는 것이죠.

트랜스포머 주의력 비용 절감: 이 작은 어휘 집합은 GPT나 BERT 같은 트랜스포머 기반 모델에서 또 다른 중요한 이점을 제공합니다. 바로 어텐션(Attention) 메커니즘이 처리해야 할 조합의 경우의 수를 최소화하여 학습 수렴 속도를 획기적으로 높인다는 점입니다. 데이터 효율성의 관점에서 보면, 마치 복잡한 식사 대신 고도로 정제된 고농축 영양제를 먹이는 것과 같습니다.

🗣️ 음성 인공지능 최적화 및 에너지 효율

👂 한글의 과학성은 듣고 말하는 AI, 즉 음성 합성(TTS) 및 인식(ASR) 모델에서도 빛을 발합니다. 한글은 하나의 기호가 하나의 음소(Phoneme)에 정확히 대응하는 구조를 갖추고 있습니다. (글자 = 발음) 이는 영어처럼 발음이 표기와 다른 언어(예: 'read'의 과거형/현재형)와 달리, 모델이 복잡한 발음 규칙을 따로 학습할 필요가 없다는 의미입니다. 그 결과, 한글 기반의 음성 AI는 정확도가 높고, 출력되는 음성의 자연스러움이 탁월해집니다.

♻️ 이러한 전반적인 기술적 효율은 경제적, 환경적 이점으로 이어집니다. 한글 모델의 경량화(Lightweight Model)와 빠른 학습 시간(Fewer Epochs)은 고성능 GPU의 사용 시간을 줄여줍니다. 이는 곧 AI 인프라 운영 비용을 절감하고, AI 학습 과정에서 발생하는 환경적 탄소 발자국까지 줄여주는 지속 가능한 이점을 제공합니다. 한글은 성능과 효율, 그리고 환경까지 생각하는 착한 언어 모델인 셈이죠.

🛡️ 오류 내성 및 미등록어 처리의 용이성

🚧 AI가 인터넷상의 데이터를 학습하다 보면 오타나 신조어, 혹은 띄어쓰기 오류 같은 '노이즈'를 필연적으로 만나게 됩니다. 특히 미등록어(OOV, Out-of-Vocabulary)는 자연어 처리에서 모델의 성능을 떨어뜨리는 주범입니다.

🗣️ 여기서 한글의 모듈식 구성이 빛을 발합니다. 다른 언어 모델은 "점심 머겄엉"이라는 오타나 'ㅋㄷㅋㄷ', 'OTL' 같은 비정형적인 신조어를 만나면 글자 전체를 버리거나 새로운 토큰으로 억지로 등록해야 하지만, 한글은 어떤 형태의 음절이든 기본 자모 단위로 쪼개서 분석할 수 있습니다. 💡

🎯 예를 들어, "머겄엉"이라는 잘못된 음절도 'ㅁ(초성) + ㅓ(중성) + ㄱ(종성)'으로 분해되므로, 모델은 글자 전체를 버리지 않고 최소한의 음가 정보를 활용해 원래 단어('먹었어')를 유추하거나 교정할 수 있죠. 이런 강력한 오류 내성은 언어의 '신진대사'를 원활하게 만들어, 불완전한 입력에도 불구하고 안정적인 출력을 가능하게 합니다.

🌍 한글의 글로벌 비교 우위: AI 학습의 효율성 대결

한글의 구조적 효율성은 전 세계 주요 문자 시스템과 비교했을 때 더욱 극명하게 드러납니다. AI가 언어를 배우는 과정에서 한글은 독보적인 경쟁 우위를 제공하며, 이는 모델의 개발 비용과 성능에 직접적인 영향을 미칩니다.

🆚 중국어(한자)와의 '용량' 전쟁

수만 개의 글자를 사용하는 중국어(한자) 기반 언어 모델은 엄청난 양의 토큰을 어휘 집합에 포함해야 합니다. 이로 인해 모델의 크기가 커지고 학습 시간이 길어지며, 필연적으로 더 많은 컴퓨팅 자원을 요구하게 됩니다. 반면, 한글은 51개의 기본 자모와 조합 규칙만으로 모든 소리를 표현합니다. 📚 이는 데이터 학습 밀도 면에서 한자 기반 언어 대비 압도적인 효율 차이를 만들어내며, AI 모델에게 '최소 요소로 최대 조합'을 달성하는 학습의 청사진을 제시합니다.

🧩 일본어(혼합 문자)의 복잡성과 대비

일본어는 히라가나, 가타카나, 한자를 혼용하는 혼합 문자 시스템을 사용합니다. 이 세 가지 문자가 복잡하게 얽히는 구조는 토큰화 과정에서 모델에게 매우 높은 난이도의 해석을 요구합니다. 모델은 입력된 텍스트가 어떤 문자에 해당하는지, 그리고 어떤 방식으로 쪼개져야 하는지를 판단하기 위해 여러 복잡한 경로를 거쳐야 합니다. 🚧 이와 달리, 한글은 단일하고 통일된 모듈식 구조를 갖추고 있어 토큰화 파이프라인을 간결하고 일관성 있게 유지합니다. 결과적으로, 일본어 모델 대비 오류 발생 가능성이 낮고, 모델 설계가 단순하며, 학습 효율이 매우 뛰어납니다.

🚀 한글, 미래 언어 모델의 '골든 스탠더드'로

🏆 정리하자면, 한글은 단순히 배우기 쉬운 문자를 넘어, AI 시대의 데이터 효율성과 연산 속도를 극대화하는 구조적 우월성을 가지고 있습니다. 우리가 일상에서 사용하는 'ㄱ' 하나, 'ㅏ' 하나가 사실은 AI의 학습 속도를 가속화하고 연산 비용을 절감하는 핵심 부품이었던 셈이죠.

📈 이러한 기술적 우위는 한국어 기반 AI 산업이 세계 무대에서 빠르게 성장할 수 있는 강력한 기반이 됩니다. 다른 언어들이 복잡한 토큰화와 대규모 데이터셋으로 싸울 때, 한글은 적은 자원으로 최대 효율을 뽑아내는 최고의 '시스템 디자인'을 제공하는 것입니다. 이처럼 한글의 우수성을 기술적으로 이해하고 나니, 세종대왕께 다시 한번 감사 인사를 전하고 싶어지네요!

🤔 이처럼 혁신적인 한글의 구조를 활용하여, 현재 개발 중인 AI 서비스나 개인 프로젝트에 적용할 만한 구체적인 아이디어가 떠오르시나요? 이 글에서 언급된 글로벌 효율성 비교 같은 부분을 더 강조하거나, 다음 단계로 나아갈 수 있는 다른 관점을 함께 모색해 봐도 좋을 것 같습니다.

'최신 트랜드 읽기' 카테고리의 다른 글

| 🐜 성경 속 '블록체인'의 비밀: 감독 없는 개미 사회가 Web 3.0에 던지는 질문 (56) | 2025.10.15 |

|---|---|

| 🤖 미래 교육의 골든 키: 한글, 20억 인구의 디지털 문맹 퇴치 솔루션 (126) | 2025.10.10 |

| 📝 전 세계가 인정한 한국의 보물: 한글의 유네스코 세계기록유산 등재, 그 진정한 의미 (15) | 2025.10.10 |

| 📱 노벨상 수상자에게 전화가 닿지 않았을 때: 기술 의존성에 대한 가장 드라마틱한 풍자 (65) | 2025.10.08 |

| 🍎 추석 과일, 칼로리 폭탄? 배, 사과, 감, 포도의 영양학적 분석과 건강 섭취법 (119) | 2025.10.03 |